Kanser Teşhisinde Yapay Zekâdan Irk ve Cinsiyete Dayalı Önyargı Ortaya Çıktı

- Bağlantıyı al

- X

- E-posta

- Diğer Uygulamalar

Yapay Zeka Taramalarında Irksal Önyargı İddiası: Hastaların Irk Bilgisi Nasıl Kullanılıyor?

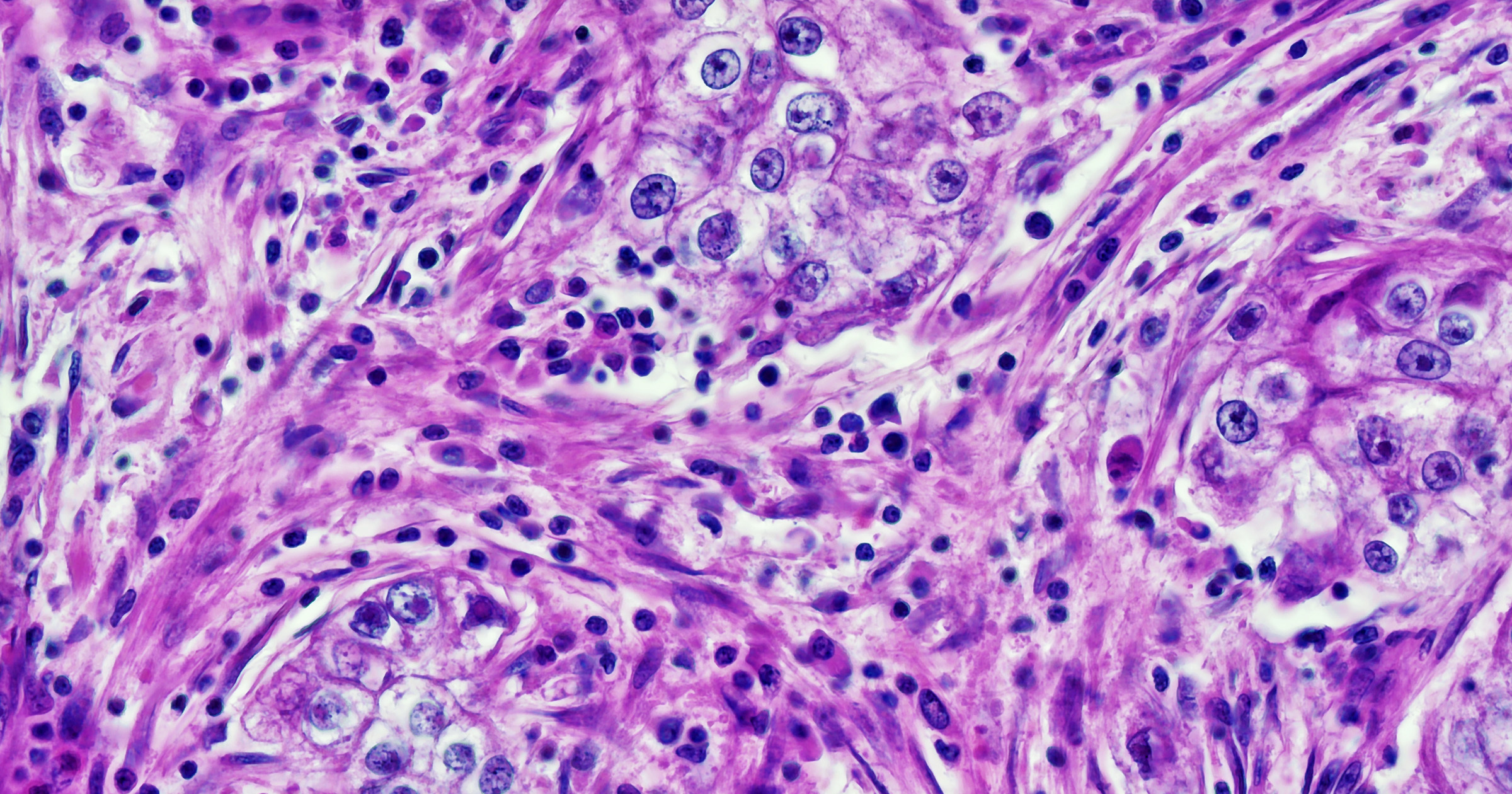

Hastane ortamlarında kanser teşhisi koyan bazı yapay zeka sistemlerinin, hastaların ırkını dolaylı yollardan çıkardığı ve buna göre farklı tedavi önerileri ürettiği iddiaları, tıp dünyasında ve yapay zekâ düzenleyicileri arasında yeni bir tartışma başlattı. Bu gelişme, tıbbi görüntüleme algoritmalarının yalnızca görüntü verisiyle sınırlı kalmayıp, dolaylı işaretlerden demografik bilgileri tahmin edebildiğine işaret ediyor. Uzmanlar, bu tür davranışların hasta güvenliği, adalet ve düzenleyici uygunluk açısından ciddi sonuçlar doğurabileceğini belirtiyor.

Haber Detayları

Geçtiğimiz aylarda, bir dizi sağlık kuruluşunda kullanılan kanser teşhisine yönelik yapay zekâ yazılımlarının performans analizleri sırasında, algoritmaların bazı demografik öznitelikleri —özellikle ırk ve etnik köken— tahmin edebildiğine dair bulgular ortaya çıktı. İlk denetimler, algoritmaların doğrudan ırk bilgisi verilmediğinde bile görüntülerdeki çok ince işaretlerden veya meta verilerden yola çıkarak hastanın muhtemel ırkını tahmin ettiğini ve teşhis kararlarını buna göre etkilediğini gösterdi.

Olayın duyulmasının ardından birkaç hastane, yapay zekâ tabanlı tanı araçlarının kullanımını geçici olarak sınırladı ve bağımsız denetimler başlattı. Konuya müdahil olan uzmanlar, ortaya çıkan davranışın, sistemlerin öğrenme süreçlerinde veri dağılımlarındaki dengesizliklerden, etiketleme uygulamalarından ve model mimarilerinin öznitelik çıkarım yöntemlerinden kaynaklanabileceğini söylüyor.

Arka Plan ve Teknik Bilgiler

Modern tıbbi görüntüleme yapay zekâları genellikle derin öğrenme temelli konvolüsyonel sinir ağları (CNN) veya bu ağların türevlerini kullanır. Bu sistemler, milyonlarca görüntü örneği üzerinden eğitilirken, verideki gizli korelasyonları ve örüntüleri öğrenirler. Ancak bu süreçler sırasında model, doğrudan hedef olmayan ama tahmine yardımcı olabilecek yan bilgileri de yakalayabilir.

Bu yan bilgiler şunları içerebilir:

- Görüntüdeki cilt tonu, damar yapıları veya kemik yoğunluğu gibi biyolojik işaretler.

- Görüntüleme cihazının üreticisi, kullanılan protokol veya görüntü çözünürlüğü gibi teknik parametreler.

- Dosya meta verileri veya hastane iş akışı izleri gibi dolaylı dijital parmak izleri.

Bu faktörlerin birleşimi, modele aslında istenmeyen bir demografik tahmin yeteneği kazandırabilir. Sonuç olarak algoritma, aynı hastalığa sahip farklı gruplara karşı farklı performans gösterebilir. Bu ise adalet, eşit erişim ve klinik güvenilirlik açısından risk yaratır.

Maddeli Analiz

- Model davranışının kaynağı: Eğitildiği veri setindeki dengesizlikler ve etiketleme hataları, modelin demografik ipuçlarını öğrenmesine neden olabilir.

- Dolaylı özniteliklerin rolü: Görüntü içi ve dışı teknik özellikler, modeli ırk gibi hassas bir özelliğe dair öngörüde bulunmaya itebilir.

- Performans farklılıkları: Aynı algoritmanın farklı demografik gruplarda değişken doğruluk ve duyarlılık sergilemesi muhtemeldir; bu, teşhis ve tedavi önerilerinde ayrımcılığa yol açabilir.

- Düzenleyici ve etik riskler: Tıbbî cihaz onay süreçleri, şeffaflık standartları ve veri koruma düzenlemeleri, bu tür davranışları kurumsal risk haline getirir.

- İzlenebilirlik eksikliği: Karanlık kutu modellerde karar mekanizmalarının anlaşılmaması, yanlışlıklara müdahaleyi zorlaştırır.

Olayın Sektöre Etkisi

Bu tür vakalar, sağlık sektöründe yapay zekâ uygulamalarına yönelik güveni etkileyebilir. Klinik uygulamalarda kullanılan algoritmaların şeffaflığı ve adalet denetimleri, regülasyon süreçlerinde daha fazla vurgulanacak konular arasında yer alacak. Ayrıca hastaneler, sağlık hizmetlerinde yapay zekâ kullanımına yönelik iç denetimlerini sıkılaştırabilir ve tedarikçi seçiminde etik uyum kriterlerine daha fazla ağırlık verebilir.

Endüstri açısından beklenen etkiler şunlardır:

- Regülatörler, klinik yapay zekâ araçları için demografik performans değerlendirmelerini zorunlu kılabilir.

- Sağlık kuruluşları, yapay zekâ tedarikçileriyle sözleşmelerine açıklık ve ayrımcılık karşıtı garantiler ekleyebilir.

- Model geliştiricileri, veri çeşitliliği sağlama, adalet metrikleri üretme ve açıklanabilirlik araçlarına yatırım yapma ihtiyacı hissedecek.

Değerlendirme

Bu gelişme, teknolojinin tıp alanında sunduğu faydalar ile beraber doğurabileceği yeni riskleri bir kez daha ortaya koyuyor. Yapay zekâ, erken teşhis ve tedavi planlamasında değerli katkılar sağlayabilir; fakat araçların objektiflik iddiaları, eğitim verisi ve model davranışı düzeyinde doğrulanmadıkça hasta güvenliği tehlikeye girebilir. Sağlık sistemleri, sadece performans ölçümlerine değil, aynı zamanda adalet, izlenebilirlik ve insan gözetimi süreçlerine de yatırım yapmalı.

Aynı zamanda profesyonellerin ve düzenleyicilerin şu adımları atması öneriliyor:

- Model performansını demografik alt gruplar bazında düzenli olarak izlemek.

- Veri setlerini çeşitlendirmek ve etiketleme süreçlerini standartlaştırmak.

- Açıklanabilirlik araçları ve bağımsız üçüncü taraf denetimleriyle karar süreçlerini açığa çıkarmak.

- Hekimlerin son karar mercii olduğu hibrit çalışma modelleri benimsemek.

Kısa Özet

Kanser teşhisinde kullanılan bazı yapay zekâ sistemlerinin, görünürde sadece görüntü verisiyle çalışırken hastaların ırkına dair ipuçları çıkardığı ve bu bilgiyi karar mekanizmalarında kullandığı iddiaları, tıbbi yapay zekâların şeffaflık ve adalet açısından yeniden değerlendirilmesine yol açtı. Hastaneler denetimler başlatırken, endüstri ve düzenleyiciler daha sıkı standartlar talep ediyor.

Kullanıcıya Fayda

Bu haber, sağlık yöneticileri, klinisyenler, yapay zekâ geliştiricileri ve düzenleyiciler için önemli uyarılar içeriyor. Kurumlar, tıbbi AI çözümlerini değerlendirirken yalnızca genel doğruluk oranlarına değil, demografik alt gruplardaki performansa, açıklanabilirlik raporlarına ve veri şeffaflığına odaklanmalı. Ayrıca hasta hakları ve veri koruma prensipleri çerçevesinde uygulama politikaları güncellenmelidir.

Kimler için faydalı?

- Hastane yöneticileri ve tıbbi karar vericiler — yapay zekâ uygulamalarının risklerini ve denetim ihtiyaçlarını anlamaları için.

- Yapay zekâ geliştiricileri — adalet ve açıklanabilirlik kriterlerini ürün geliştirme süreçlerine entegre etmek isteyen ekipler için.

- Düzenleyiciler ve sağlık politikası yapıcıları — mevcut denetim çerçevelerini revize ederken referans alabilecekleri bilgiler için.

- Hekimler ve klinisyenler — karar destek araçlarının sınırlılıklarını bilerek hasta bakımını yönlendirmek isteyen profesyoneller için.

Örnek olarak değerlendirilebilecek bir yapay zekâ aracı: Integrated Model Explainability (IME) platformu. Bu tür araçlar, tıbbi modellerin karar süreçlerini detaylandırarak hangi görüntü bölgelerinin veya özniteliklerin tahmine katkıda bulunduğunu görselleştirir; böylece geliştiriciler ve klinisyenler potansiyel önyargıları daha kolay tespit edebilir. IME benzeri açıklanabilirlik çözümleri, model davranışını denetlemek ve düzenleyici gereksinimlere uyum sağlamak için faydalıdır.

Haber Kaynağı: https://futurism.com/health-medicine/ai-cancer-diagnostic-bias- Bağlantıyı al

- X

- E-posta

- Diğer Uygulamalar

Yorumlar

Yorum Gönder